100년 묵은 어휘로 새 풍경을 그릴 수 있을까

운영적 탁월함(Operational Excellence)이라는 용어에는 100년의 학문적 무게가 실려 있다.

1920년대 벨연구소에서 Walter A. Shewhart가 통계적 공정관리를 정립한 이후, W. Edwards Deming, Joseph Juran을 거쳐 1950년대 토요타 공장에서 Taiichi Ohno와 Shigeo Shingo가 만든 토요타 생산방식, 1986년 Motorola에서 Bill Smith가 시작한 식스시그마, 1995년 Jack Welch가 GE에서 폭발시킨 전사 운동까지. 이 모든 흐름이 한 가지 전제 위에 서 있다. 운영의 주체는 인간이고, 운영적 탁월함이란 그 인간 노동자의 행동을 어떻게 조직할 것인가의 문제라는 전제다.

이 전제가 흔들리고 있다.

2022년 말 GPT-3.5의 등장 이후 약 3년이 지난 지금, AI 에이전트는 단순한 자동화 도구가 아니라 판단의 일부를 위임받는 행위자로 운영 현장에 들어왔다. 제조 라인의 품질 검사, 병원의 영상 진단 1차 판독, 법무팀의 계약 검토, 회계팀의 거래 분류, 채용팀의 이력서 스크리닝 — 이 모든 영역에서 AI가 결정의 일부를 대신하는 풍경이 일상이 되어가고 있다.

문제는 이 변화에 대한 체계적 이론이 아직 없다는 것이다. Hyperautomation, AI-First Operations, Agentic Workflow 같은 새 어휘들이 쏟아지고 있지만, 이들 중 어떤 것이 진짜 패러다임 전환을 포착하고 어떤 것이 마케팅 어휘인지는 아직 검증되지 않았다.

이 글은 정답을 제시하지 않는다. 다만 다음 세 가지를 시도한다. i) 100년 묵은 OpEx 어휘 중 어떤 것이 살아남고 어떤 것이 변형되어야 하는지에 대한 가설, ii) AI-native 환경에서 새롭게 등장하는 패턴들에 대한 명명, 그리고 iii) 이 변화가 운영이라는 일의 정의 자체를 어떻게 다시 그리고 있는지에 대한 관찰. 어떤 가설은 5년 후 다시 보면 절반은 틀렸을 수 있다. 그러나 가설을 세우고 검증하는 작업은 지금 누군가가 하고 있어야 한다.

운영의 목적함수가 이동하고 있다

전통 OpEx의 목적함수는 한 줄로 요약된다. “낮은 비용으로, 일관되게, 신뢰할 수 있게 가치를 전달한다.”

세 가지 키워드 — 비용, 일관성, 신뢰성 — 모두 변동성을 줄이는 방향이다. 토요타의 Heijunka(생산 평준화), 식스시그마의 Variation Reduction, 그 모두에 깔린 Process Capability 측정 — 이름은 다르지만 본질은 동일하다. 변동을 적으로 두고 변동과 싸운다.

AI-native 환경에서 이 목적함수가 다음과 같이 이동하고 있다는 가설을 세워볼 수 있다. “빠르게 적응하고, 끊임없이 증폭되며, 인간 판단의 가치가 가장 잘 드러나도록 가치를 전달한다.”

새 키워드는 Adaptability(적응성), Amplification(증폭), Human Leverage(인간 레버리지). 모두 변동성을 활용하는 방향이다. 이게 가장 큰 패러다임 전환이고, 만약 이 가설이 맞다면 OpEx 어휘 거의 전체를 다시 손봐야 한다.

다음 표는 그 이동을 정리한 가설이다. 단정적 진술이 아니라 지금 시점에서 가장 그럴듯한 방향에 대한 메모로 읽으면 된다.

| 차원 | 전통 OpEx | AI-Native OpEx (가설) |

|---|---|---|

| 핵심 목적 | 비용 최소화 | 적응 속도 최대화 |

| 변동성 | 적. 줄여야 할 대상 | 신호. 활용 대상 |

| 표준화 | 인간 행동의 표준화 | AI 행동의 표준화 + 인간 판단의 비표준화 보호 |

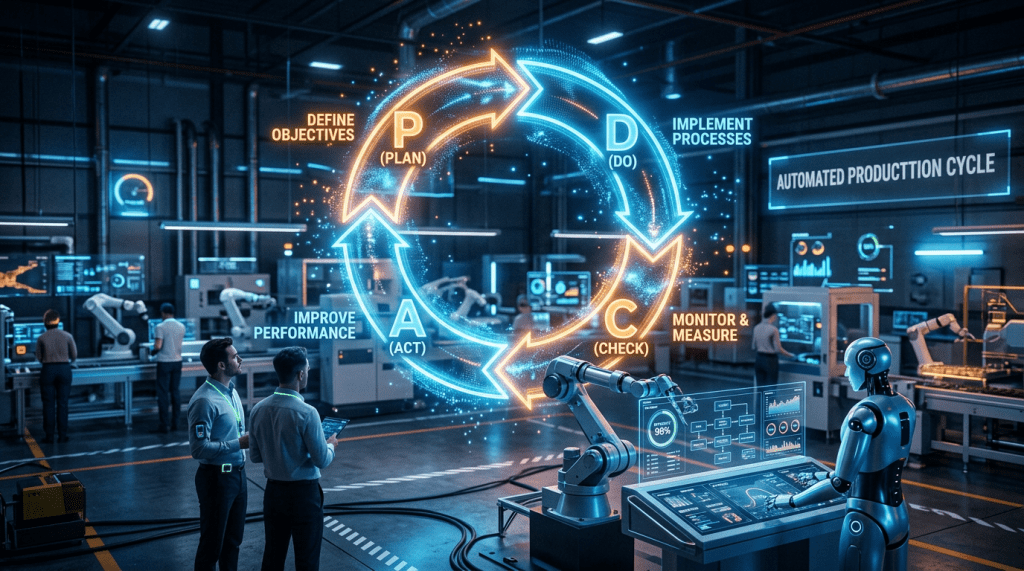

| 개선 사이클 | 분기/월 단위 PDCA | 일/시간 단위 PDCA |

| 핵심 자원 | 잘 훈련된 인력 | 잘 설계된 AI + 적은 수의 고숙련 인간 |

| 품질의 정의 | 결함 없음 | 컨텍스트 적합성 |

| 확장의 한계 | 인력 채용 속도 | AI agent 설계·검증 속도 |

| 리더의 역할 | 표준 정착 | 가드레일 설계 + 판단 위임 결정 |

이 표의 각 항목을 다음 섹션들에서 하나씩 풀어가겠다.

7대 낭비가 다시 쓰이고 있다

토요타가 정의한 7대 낭비(Seven Wastes, 七つのムダ)는 영어 약어 TIMWOOD 또는 DOWNTIME으로 외운다. Transportation, Inventory, Motion, Waiting, Overproduction, Overprocessing, Defects. 이 분류는 물리적 제조를 가정한 것이라, 지식 노동 영역에 그대로 적용하기엔 맞지 않는 부분이 있다. AI-native 환경에서는 이 분류가 새로 쓰여야 한다는 게 가설이다.

다음 7가지를 AI-Native 7대 낭비로 제안한다. 이건 학계에서 정립된 분류가 아니라 현장 관찰에서 추출한 잠정 분류이고, 더 좋은 분류가 곧 등장할 거라고 본다.

Hallucination Waste(환각 낭비). 검증되지 않은 AI 출력이 시스템에 흘러 들어가 후속 작업을 오염시킨다. 의료에서는 잘못된 진단 추천이, 법무에서는 존재하지 않는 판례 인용이, 재무에서는 잘못된 거래 분류가 흘러간다. 가장 위험한 낭비. 이걸 막는 것이 AI-native 운영의 첫 번째 원칙이고, 토요타 Jidoka(문제 시 라인 정지)에 해당하는 AI 시대 버전이 필요하다.

Verification Waste(검증 낭비). AI가 100을 만들었는데 인간이 100을 다 검증하면 자동화의 의미가 없다. 그러나 0을 검증하면 hallucination이 흘러간다. 어디까지 검증할 것인가의 균형 설계 — 통계적 표본 검사(Statistical Quality Control)의 현대 버전이다. 100년 전 Shewhart의 통찰이 가장 살아 있는 영역이 역설적으로 AI 시대다.

Context Loss Waste(컨텍스트 손실 낭비). AI 에이전트 간 작업 전달에서 컨텍스트가 휘발된다. 인간 동료는 “지난번에 그 환자/고객/거래처 이런 사정 있었잖아”를 기억하지만, AI는 명시되지 않으면 모른다. 토요타의 Yokoten(横展開, 횡전개)에 해당하는 컨텍스트 전파 메커니즘 설계가 필요하다.

Prompt Drift Waste(프롬프트 표류 낭비). 같은 작업을 하는 프롬프트가 여러 사람에 의해 조금씩 다르게 작성·수정되어 결과의 일관성이 무너진다. 가장 흔한, 그리고 가장 보이지 않는 낭비. 프롬프트의 형상관리(version control)가 새로운 핵심 역량이 된다.

Premature Automation Waste(조기 자동화 낭비). 잘 정의되지 않은 프로세스를 AI로 자동화하면 나쁜 프로세스를 빠르게 실행하는 결과가 된다. Bill Gates의 자주 인용되는 명제가 AI 시대에 다시 살아난다.

“The first rule of any technology used in a business is that automation applied to an efficient operation will magnify the efficiency. The second is that automation applied to an inefficient operation will magnify the inefficiency.” (비즈니스에 쓰이는 모든 기술의 첫 번째 법칙은, 효율적인 운영에 자동화를 적용하면 효율을 증폭시킨다는 것이다. 두 번째는, 비효율적인 운영에 자동화를 적용하면 비효율을 증폭시킨다는 것이다.)

토요타 어휘로 옮기면 PDCA 전에 SDCA. 안정화되지 않은 프로세스는 자동화 대상이 아니다.

Trust Calibration Waste(신뢰 보정 낭비). AI를 너무 신뢰하거나(over-trust) 너무 불신하면(under-trust) 둘 다 낭비. 정확한 신뢰 수준을 보정하는 데 드는 인지적 비용이 의외로 크다. Calibrated Trust가 AI-native 환경의 새로운 metacognition이 된다. 항공 분야에서 자동조종(autopilot)에 대한 조종사의 신뢰 보정이 수십 년에 걸쳐 정립된 것처럼, 다른 영역들도 비슷한 학습 곡선을 거치게 된다.

Identity Erosion Waste(정체성 침식 낭비). 일하는 사람이 ‘내가 하는 일이 무엇인가’를 잃어가는 현상. 단순작업을 AI에게 넘긴 후 남은 일이 모두 어려운 판단뿐이라 번아웃이 가속된다. 이건 측정 가능한 낭비라기보다는 조직적 위험이고, 가장 새로운 낭비 유형이며, 가장 해결책이 불분명하다.

이 7가지 중 5번까지는 도구의 문제이고, 6번부터는 사람의 문제다. 진짜 어려운 건 후자다. 도구는 시간이 해결하지만, AI 시대의 신뢰 보정과 정체성 침식은 누가 어떻게 풀어야 할지 아직 잘 모른다.

PDCA가 가속하면 무엇이 일어나는가

전통 PDCA는 분기·월 단위로 돈다. 새 표준을 정하고, 시행해보고, 결과를 측정하고, 조정한다. 한 번 도는 데 보통 3~6개월. 토요타에서는 이걸 Toyota Kata라는 이름으로 학습 시스템화했고, Mike Rother가 2009년 동명의 책에서 이걸 깊이 분석했다.

AI-native 환경에서는 이 사이클이 시간/일 단위로 돌 수 있다. Plan(새 프롬프트나 에이전트 설계)에 30분, Do(일부 트래픽에 적용)에 1일, Check(결과 메트릭 자동 수집)는 실시간, Act(프롬프트 수정 또는 롤백)에 10분. 이론적으로는 하루에 PDCA 사이클을 여러 번 돌릴 수 있다.

이 가속이 주는 영향은 두 갈래다.

좋은 영향은 학습 속도의 폭발이다. 분기마다 한 번 학습하던 조직이 매일 학습한다. 누적 효과는 어마어마하다. 1년 후, 일 단위 PDCA를 돌리는 조직과 분기 단위 PDCA를 돌리는 조직 사이에는 복리적 격차가 벌어진다.

나쁜 영향은 과잉반응의 위험이다. 빠른 사이클의 함정 — 노이즈에 반응한다. 통계적 사고에 익숙하지 않은 사람은 일주일치 데이터를 보고 “이 변화 효과 있다”고 결론 내린다. 사실은 random variation일 뿐인데. Shewhart-Deming의 Common Cause vs Special Cause 구분이 AI-native 환경에서 다시 결정적으로 중요해지는 이유다.

이 점을 가장 명확하게 정리한 사람은 Deming 본인이다.

“If anyone adjusts a stable process for a result that is undesirable, or for a result that is extra good, the output that follows will be worse than if he had left the process alone.” (안정된 프로세스에 대해 누군가가 — 바람직하지 않은 결과를 보정하기 위해서든, 유난히 좋은 결과를 보정하기 위해서든 — 손을 대면, 그 다음에 나오는 출력은 그가 프로세스를 그대로 두었을 때보다 더 나빠진다.)

가설로 정리하면 이렇다. AI-native 환경의 핵심 역량 중 하나는 언제 반응하지 않을지를 아는 능력이 될 것이다. 모든 메트릭 변화에 반응하면 시스템이 발산한다. 빠른 사이클에서 천천히 결론 내리는 인내력이 가장 어려운 운영 기술이 된다.

운영 조직의 모양이 바뀌고 있다

운영 조직의 인적 구성에 대한 가설 두 가지가 흥미롭다.

첫째, 평균 인원은 줄고 평균 영향력은 커진다. 전통적으로 운영 조직은 사업 규모에 따라 거의 선형적으로 커졌다. 매출 두 배에 헤드카운트 두 배. AI-native 환경에서는 이 선형성이 깨진다. 사업이 두 배가 돼도 운영 조직은 그만큼 커지지 않는다. 대신 한 명 한 명의 책임 범위는 훨씬 넓어진다. 작은 정예 + 강력한 AI 인프라의 조합. 이건 좋은 일만은 아니다 — 한 사람의 실수가 미치는 영향이 그만큼 커지기 때문에, 채용 기준과 권한 위임 기준이 모두 바뀌어야 한다.

둘째, T자형 인재에서 π자형 인재로의 이동이 일어나고 있다. T자형은 한 영역의 깊이 + 다양한 영역의 넓이로 정의되는 2010년대 인재 모델이었다. π자형은 두 영역의 깊이 + 그 둘을 연결하는 능력. AI-native 시대의 인재 모델(가설)이다.

가장 명확한 사례 중 하나가 Legal Engineer라는 직군의 등장이다. 변호사 + AI 워크플로우 설계라는 두 다리. 의료 영역에서는 의사 + AI 진단 워크플로우 검증의 조합이 등장하고 있고, 회계 영역에서는 회계사 + 데이터 파이프라인의 조합이, 인사 영역에서는 HR + 데이터/자동화의 조합이 표준이 되어가고 있다. 도메인은 다르지만 패턴은 동일하다.

a16z의 Tom Hollands는 2026년 1월 Forward-deployed Job Titles라는 글에서 이 현상을 title arbitrage(직함 차익거래)라는 이름으로 잡아냈다.

“Title arbitrage means creating new roles to signify new powers that are emerging within the organization, and therefore, new capabilities of the organization itself.” (직함 차익거래란, 조직 안에서 새로 등장하고 있는 권력을, 따라서 조직 자체의 새로운 역량을 가리키기 위해 새로운 역할을 만드는 일이다.)

Hollands가 Palantir의 Forward Deployed Engineer를 예로 들었는데, 그동안 “solutions engineer”로 저평가받던 사람들이 새 직함과 함께 회사의 핵심 인재로 격상된 사례다. AI-native 환경에서 일어나고 있는 것이 정확히 이 패턴이다. 변호사, 의사, 회계사, HR, 컴플라이언스 — 모두 전통적으로 “전문직” 또는 “지원 기능”으로 분류되던 직군들이, AI 워크플로우의 핵심 운용자라는 새 정체성을 얻으면서 직함이 바뀌고 있다.

세 번째 변화는 리더의 역할이다. 전통적 운영 리더의 역할은 프로세스 표준 정착, 팀 운영, 예산 관리였다. AI-native 환경에서 운영 리더의 새 역할(가설)은 다음 네 가지로 정리된다.

- Guardrail Designer: 어디까지 AI에게 맡길지, 어디부터 인간이 결정할지의 경계 설계

- Trust Calibrator: 조직의 AI 신뢰 수준을 적정하게 유지 (over-trust도 under-trust도 막음)

- Context Steward: 흩어지는 컨텍스트를 보존하는 시스템 운영

- Capability Investor: 어떤 AI 역량에 투자할지 결정 (단순 도구 도입이 아닌 capability building)

이 네 가지 중 어느 것도 전통 OpEx 교과서에 명시적으로 등장하지 않는다. 이게 의미하는 바는 분명하다 — 운영 리더의 직무 기술서가 5년 전에 비해 거의 새로 쓰여야 한다는 것.

운영이 처음으로 정량적 자기입증이 가능해지는 시대

이 글을 정리하면서 가장 흥미로웠던 가설이 이거다. AI-native 운영은 자기 가치를 정량적으로 입증할 수 있는 첫 운영이 된다.

전통적으로 운영의 가치를 입증하기 어려웠던 이유는 세 가지였다. 대부분의 운영 활동이 측정되지 않았다. 운영의 가치가 long-tail이었다 — 작은 개선 100개의 누적이 큰 차이를 만드는데, 개별 개선은 보이지 않았다. 그리고 운영의 산출물이 ‘무사고’였다 — 사고가 나지 않으면 아무도 운영을 떠올리지 않는다.

AI 시대에 이 세 장벽이 무너지고 있다.

첫째, 모든 워크플로우가 측정 가능해진다. AI 에이전트가 처리한 작업의 시간, 결과, 오류율이 자동 수집된다. 운영의 가치를 처음으로 수치화할 수 있다.

둘째, 개선의 누적 효과가 보이게 된다. 일 단위 PDCA의 복리 효과는 분기 단위로 가시화된다. “지난 분기 대비 50% 빨라짐” 같은 진술이 가능해진다.

셋째, 사고 예방의 가치가 보이게 된다. 이게 가장 미묘한 지점인데, AI 시스템에서는 막은 사고의 데이터가 남는다. Counterfactual visibility. AI agent가 “이 워크플로우는 위험합니다”라고 멈춘 횟수, 그래서 인간 검토로 넘어간 케이스 — 이게 다 기록된다. 전통 운영에서는 불가능했던 것이다.

이 변화가 운영의 조직 정치에 미치는 영향이 흥미롭다. 운영의 가시성과 영향력이 처음으로 핵심 사업 부문과 동등한 수준으로 올라갈 수 있는 조건이 갖춰진 셈이다.

다만 이 변화에는 함정이 있다. 측정 가능한 것에 집착하면 측정 불가능한 가치(신뢰, 분위기, 비공식 멘토링 등)가 평가절하된다. 식스시그마가 1990년대에 빠졌던 함정이다 — BusinessWeek의 Brian Hindo가 2007년에 정리한 ⟨3M의 Six Sigma 도입이 혁신 동력을 침식한 사례⟩가 가장 자주 인용되는 분석이다. 식스시그마를 적극 도입한 후 측정 가능한 효율은 얻었지만 혁신 동력은 잃었다는 진단인데, AI 시대에 같은 함정이 더 정교한 형태로 다시 등장할 수 있다는 점은 의식해둘 필요가 있다.

새로운 5원칙 — 잠정적 가설

위의 논의들을 종합해서, 잠정적인 AI-Native OpEx의 5원칙을 제시한다. 학문적으로 검증된 정답이 아니라 지금 시점에서 가장 그럴듯해 보이는 가설이다.

원칙 1. 인간 판단을 보호하라(Protect Human Judgment). AI가 잘하는 것을 AI에게 넘기는 것이 자동화의 목적이 아니다. 자동화의 진짜 목적은 인간의 시간을 인간만이 할 수 있는 판단에 쓰게 하는 것이다. 이걸 잊으면 자동화는 그냥 비용 절감 도구로 전락한다. LegalOn의 Global CEO Daniel Lewis가 2025년 7월 TechCrunch 인터뷰에서 한 말이 이 원칙을 가장 잘 정리한다.

“The things AI can’t do perfectly today are, by definition, the things only people can do. And the lawyers who lean into that responsibility — to oversee, to edit, to exercise judgment — are the ones seeing the most extraordinary leverage from AI right now.” (오늘날 AI가 완벽하게 할 수 없는 일은, 정의상, 사람만이 할 수 있는 일이다. 그리고 그 책임에 — 감독하고, 편집하고, 판단을 내리는 — 기꺼이 뛰어드는 변호사들이 지금 AI로부터 가장 비범한 leverage를 얻고 있는 사람들이다.)

이 명제가 변호사에 대해 작동하면, 의사·회계사·엔지니어·관리자 누구에 대해서도 작동한다.

원칙 2. 가드레일 먼저, 자동화 나중(Guardrails Before Automation). 어떤 워크플로우든 자동화하기 전에 실패 모드와 그 가드레일을 먼저 설계한다. 토요타 Jidoka의 AI 버전이다. 모든 AI 워크플로우에 kill switch, human escalation path, anomaly detection이 들어가야 한다.

원칙 3. PDCA를 가속하되 결론은 천천히(Fast PDCA, Slow Conclusions). 사이클은 빠르게, 결론은 천천히. 일 단위 실험은 권장되지만 “이게 효과 있다”는 결론은 통계적 유의성이 확보된 후에. 모든 실험에 최소 표본 크기와 결론 유보 기간을 사전 정의하는 게 한 가지 운영 동작이다.

원칙 4. 컨텍스트는 자산이다(Context as Asset). AI-native 환경에서 가장 중요한 자산은 코드도 프로세스도 아니다. 컨텍스트의 누적이다. 조직의 history, 고객·환자·거래처 history, 의사결정의 이유, 실패의 교훈 — 이것이 잘 보존된 조직이 그렇지 않은 조직을 압도한다. 컨텍스트를 보존하는 시스템에 비대칭적으로 투자해야 한다.

원칙 5. 정체성은 일이 아니라 사람에서 온다(Identity from People, Not Tasks). 조직이 “우리가 하는 일”로 자기를 정의하면 AI가 그 일을 가져갈 때 정체성 위기가 온다. “우리가 누구를 위해 무엇을 만드는가”로 자기를 정의해야 한다 — 즉, 사람을 위한 경험을 만드는 사람들. 이 정체성은 AI가 가져갈 수 없다.

5번이 가장 추상적이고 가장 중요하다. 조직의 미션 statement를 작업 목록이 아닌 서비스 받는 사람의 경험의 언어로 다시 쓰는 것 — 이게 AI-native 시대의 조직이 살아남는 가장 단단한 토대다.

적응 속도가 새 해자(moat)다

마지막으로 한 발 더 나아간 가설 하나를 제시한다. AI-native 시대의 새 경쟁 우위는 조직의 적응 속도다.

전통적 해자는 브랜드, 네트워크 효과, 규모, IP였다. 이것들은 여전히 작동하지만, 그 위에 한 층이 더 얹어지고 있다. 같은 AI 도구를 가지고도 어떤 조직은 일주일에 한 번 학습하고 어떤 조직은 분기에 한 번 학습한다. 1년 누적되면 격차는 비교 불가능해진다.

이 가설이 옳다면, 운영의 핵심 역할이 조직의 적응 속도를 만들고 유지하는 것으로 재정의된다. 운영이 단순히 조직을 굴러가게 하는 인프라가 아니라 조직이 학습하는 속도 자체를 결정하는 장치가 되는 것이다.

전통적 운영의 본질은 효율 vs 속도의 트레이드오프 곡선을 따라 조직을 움직이는 것이었다. 효율을 올리면 속도가 떨어지고, 속도를 올리면 효율이 떨어진다. AI-native 시대의 단서는 그 곡선 자체가 위로 옮겨가고 있을 가능성이다 — 효율도 속도도 동시에 올릴 수 있는 운영이 가능해진다는 것. 이게 검증된 명제는 아니다. 다만 운영의 가치 명제 자체가 다시 그려지고 있다는 것은 분명해 보인다.

마무리 — 정답은 책에서 나오지 않는다

이 글이 제시한 가설들이 옳은지는 5년 후에야 알 수 있다. 그러나 한 가지는 지금 분명하다 — 이 분야의 정답은 책에서 나오지 않는다. 토요타 생산방식이 토요타라는 회사의 50년 실험에서 나왔듯, AI-Native OpEx도 지금 이 시대의 현장에서 일하는 사람들의 실험에서 나온다. Taiichi Ohno가 1950년대 토요타 공장 라인에서 한 일을, 2026년의 누군가가 사무실의 디지털 워크플로우 위에서 하고 있다. 어휘는 다르지만 본질은 같다 — 자기 일에 대해 가장 깊이 생각하고, 작은 실험을 끊임없이 누적하고, 그 결과를 공유 자산으로 만드는 사람들이 결국 새 표준을 만든다.

이 글을 정리하면서 가장 오래 멈췄던 지점은 세 가지다.

하나는 OpEx의 어휘가 거의 그대로 살아남는다는 점이다. 처음 이 글을 구상할 때는 “100년 묵은 OpEx 어휘는 이제 안 맞으니 새 어휘를 만들어야 한다”는 도발적 입장으로 갈까 고민했다. 그러나 7대 낭비, PDCA, Jidoka, 5 Whys, Yokoten 같은 토요타 어휘들을 하나씩 점검하면서 이 어휘들이 의외로 강건하다는 걸 다시 확인했다. 적용 대상이 인간 노동자에서 AI 에이전트로, 물리적 라인에서 디지털 워크플로우로 옮겨가는 것뿐이다. 이건 어휘의 강건함을 보여주는 동시에, 우리가 운영을 사고하는 정신 모델 자체가 토요타 공장에서 만들어진 모델 위에 아직도 서 있다는 사실에 대한 묘한 자각도 준다.

다른 하나는 운영의 가시성이 정말로 이번 사이클에서 바뀔 가능성이 있다는 점이다. 운영은 100년 동안 “조용히 잘 굴러가게 하는” 역할이었다. 그게 미덕이었다. 그런데 AI 시대에 운영의 모든 활동이 측정 가능해지고, 막은 사고까지 데이터로 남고, 운영 개선의 복리 효과가 분기 단위로 가시화되면서, 운영이라는 일의 사회적 위치가 다시 그려질 가능성이 보인다. 이게 조용한 미덕의 시대에서 입증 가능한 임팩트의 시대로의 이동이라면, 운영을 업으로 삼는 사람들의 커리어 구조 자체도 바뀐다.

세 번째는 가장 인간적인 운영이 가장 자동화된 운영이라는 역설이다. AI에게 가장 많이 위임할 수 있는 조직은 AI에 위임하지 못하는 것이 무엇인지를 가장 정확히 아는 조직이다. 이런 조직은 동시에 가장 인간적인 작업에 가장 많이 시간을 쓰는 조직이 된다. 한 명 한 명의 1:1, 어색한 피드백 대화, 컬처를 만드는 한 줄짜리 운영 규칙들 — 이런 일에 더 많은 시간을 쓰는 곳이 결국 AI를 가장 깊이 활용하는 곳이 된다는 가설은 처음 들으면 모순처럼 들리지만, 자세히 보면 가장 정확한 명제일 수 있다.

이 세 지점이 5년 후에도 옳은 진단으로 남을지는 모르겠다. 다만 가설을 세우고 검증하는 작업 자체는 지금 시작해야 한다. 왜냐하면 이 분야의 정답은 학문에서 내려오는 것이 아니라 현장의 누군가가 만드는 것이기 때문이다.

위의 가설들은 추상적 명제가 아니라 매주 결정해야 하는 구체적 질문들이다. 어디까지 AI에게 맡길 것인가. 검증을 어떤 비율로 할 것인가. 멤버 한 명의 정체성이 흔들릴 때 어떻게 받쳐줄 것인가. 운영 데이터가 처음으로 보이기 시작할 때, 그 가시성을 무엇을 위해 쓸 것인가. 이 질문들에 대한 답은 매번 다르고, 매번 잠정적이다. 다만, 그 답을 만드는 자리가 이 시대 운영을 업으로 삼은 사람들의 가장 흥미로운 자리라는 것은 분명해 보인다.

댓글 남기기